北京时间6月16日消息,本周四Facebook在介绍自己对于恐怖虚假信息处理工作时表示,技术可以是解决方案的一部分。直到最近,Facebook才在反恐方面使用AI技术。其中使用的一种技术就是图像匹配。

Facebook用AI识别恐怖和虚假消息(图片来自baidu)

Facebook表示,如果用户发布一张图片,上面出现了已知的恐怖分子,Facebook软件就会自动匹配,比如将图片与ISIS的宣传视频匹配,或者与Facebook上出现的其它极端图片和视频匹配,这些图片视频已经被删除。

不只如此,Facebook还在做实验,对网站上恐怖分子可能使用的语言进行解析。Facebook还准备扩大技术的应用范围,用在其它App中,包括Whats App和Instagram。

据了解,现在Facebook每月有用户20亿。在过去几个月里,Facebook受到了假新闻的困扰。一些人还用Facebook Live直播谋杀、暴力内容。在反恐问题上,Facebook认为技术并不是完美的“答案”,它还依赖人力来控制。Facebook反恐团队已经有150名成员,有些人之前是检查官,或者来自执法机构,或者是工程师。

Facebook全球政策管理主管莫妮卡·比科特(Monika Bickert)、反恐政策经理布莱恩·菲什曼(Brian Fishman)在博文中表示:“我们的立场非常简单:在Facebook没有恐怖分子的容身之地。我们删除恐怖主义内容以及支持恐怖主义的内容,一旦发现就会删除。当我们收到报告,说某些帖子可以涉及恐怖主义,我们马上会对帖子进行评估审查。”

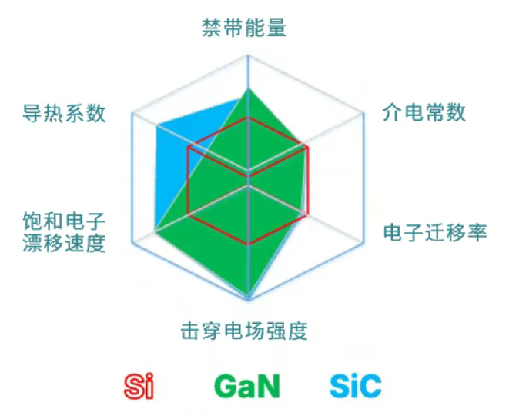

碳化硅赋能浪潮教程:SiC JFET驱动工业与服务器电源革新

碳化硅赋能浪潮教程:SiC JFET驱动工业与服务器电源革新 【首发】上海晶珩发布树莓派CM5龙虾盒子!要知道,你离AI私有化只差一个盒子!

【首发】上海晶珩发布树莓派CM5龙虾盒子!要知道,你离AI私有化只差一个盒子! 腾讯云TVP走进银河通用×NVIDIA×福田戴姆勒,解码AI驱动产业硬核突围之路

腾讯云TVP走进银河通用×NVIDIA×福田戴姆勒,解码AI驱动产业硬核突围之路 OpenClaw + 树莓派全栈部署手册:上海晶珩整理的最全避坑指南!

OpenClaw + 树莓派全栈部署手册:上海晶珩整理的最全避坑指南!

慧聪电子网微信公众号

慧聪电子网微信公众号

慧聪电子网微信视频号

慧聪电子网微信视频号

精彩评论