5月13日,瑞芯微Rockchip正式宣布,旗下AI芯片RK1808、RK1806适配百度飞桨(PaddlePaddle)开源深度学习平台,充分兼容飞桨轻量化推理引擎PaddleLite。此次瑞芯微与百度合作,旨在为AI行业赋能更多应用场景,加速AI产品落地进程。

(百度飞桨与瑞芯微兼容性认证书)

在AI时代,深度学习框架和操作系统类似,起着承上启下的作用,连接芯片与应用。拥有强大算力的AI芯片加持,AI技术将得到更广泛普及。

NPU时代来临软硬结合性能优化

瑞芯微AI芯片RK1808及RK1806,内置独立NPU神经计算单元,INT8算力高达3.0TOPs;采用22nmFD-SOI工艺,相同性能下的功耗相比主流28nm工艺产品降低约30%,在算力、性能、功耗等指标上均有优异的表现。

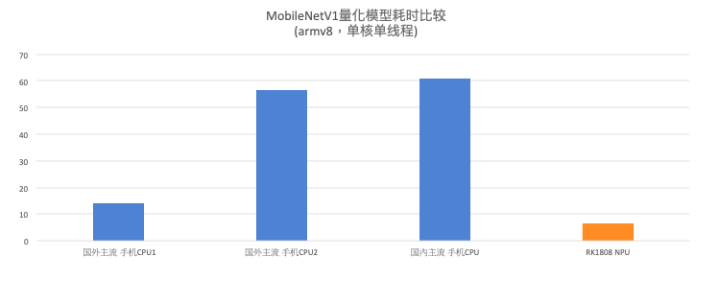

经实测,瑞芯微AI芯片在PaddleLite中运行MobileNetV1耗时仅为6.5ms,帧率高达153.8FPS,二者充分兼容并高效稳定运行。

飞桨产业级深度学习开源平台以百度多年的深度学习技术研究和产业应用为基础,集深度学习核心训练和预测框架、基础模型库、端到端开发套件、工具组件和服务平台于一体,2016年正式开源,是中国极 具影响力的全面开源开放、技术领 先、功能完备的产业级深度学习平台。PaddleLite是飞桨推出的一套功能完善、易用性强且性能卓越的轻量化推理引擎,支持多种硬件、多种平台,具备轻量化部署、高性能实现等重要特性。

(瑞芯微RK18xx系列芯片适配PaddleLite)

如下图所示的实测结果可以看出,与手机等移动端常用的国内外主流CPU相比,RK18系列NPU在MobileNET_v1的耗时表现出色,由此证明在AI相关领域,如图像分类、目标检测、语音交互上,专用的AI芯片将带来更出色的效果。

(瑞芯微RK18xx系列芯片在MobileNETV1上对比主流CPU性能卓越)

通过适配飞桨开源深度学习平台,瑞芯微芯片将能更好地赋能国内用户的业务需求,为端侧AI提供强劲算力;二者的融合,将充分发挥软硬件结合的优势,加快开发部署速度,推动更多AI应用的落地。

国产芯合作升级实操教程详解

瑞芯微AI芯片在飞桨上的详细操作方法可参考PaddleLite文档,内容涵盖支持的芯片、设备列表、Paddle模型与算子及参考示例演示等等。

(搜索路径:百度搜索“Paddle-Lite文档”,左下角选择版本release-v2.6.0,部署案例板块“PaddleLite使用RKNPU预测部署”)

测试设备(RK1808EVB)

此外,除RK1808及RK1806芯片解决方案外,瑞芯微旗下搭载NPU的AI系列芯片也将陆续升级适配百度飞桨,进一步深化双方合作关系,携手助力我国自主可控AI生态的构建。

中微公司重组申请获上交所受理,或成科创板“简易审核程序”首单

中微公司重组申请获上交所受理,或成科创板“简易审核程序”首单 闪极170W超充站移动电源:细节设计见真章

闪极170W超充站移动电源:细节设计见真章 金天弘科技:全球新能源能效治理领域出货规模领先的传感器提供商

金天弘科技:全球新能源能效治理领域出货规模领先的传感器提供商 超越宇树!魔法原子300台机器人群控创行业记录

超越宇树!魔法原子300台机器人群控创行业记录

慧聪电子网微信公众号

慧聪电子网微信公众号

慧聪电子网微信视频号

慧聪电子网微信视频号

精彩评论